Historia y Evolución de la IA

La inteligencia artificial (IA) no es un invento reciente; sus conceptos fundamentales se remontan a mediados del siglo XX. A lo largo de las décadas, la IA ha pasado de ser una idea teórica a convertirse en una realidad cotidiana. En esta lección exploraremos la evolución histórica de la IA, desde sus primeros pasos hasta la actualidad, destacando los hitos clave que han marcado su desarrollo.

Los inicios de la IA (años 50 y 60)

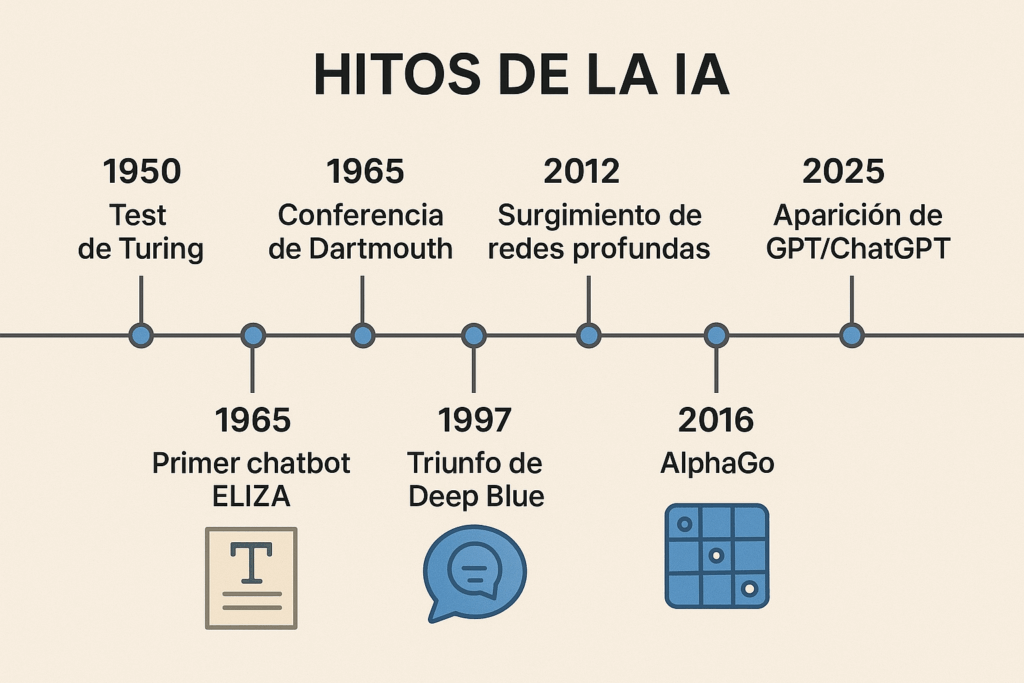

El término “inteligencia artificial” fue acuñado en 1956 durante la Conferencia de Dartmouth, un evento histórico donde científicos visionarios (como John McCarthy y Marvin Minsky) se reunieron para explorar la posibilidad de crear “máquinas pensantes”. Sin embargo, incluso antes de tener un nombre formal, ya en 1950 el matemático británico Alan Turing había planteado la idea de que una máquina podría llegar a “pensar”. Turing propuso un criterio para evaluar la inteligencia de una máquina, conocido hoy como el Test de Turing, en el cual una computadora pasa por inteligente si su conversación no puede distinguirse de la de un humano.

En los años 50, las computadoras eran muy básicas, pero estos pioneros sentaron las bases. Surgen los primeros programas que intentan imitar la inteligencia humana en campos específicos: por ejemplo, Logic Theorist (1956) podía demostrar teoremas lógicos, y en 1966 ELIZA se convirtió en uno de los primeros chatbots, simulando conversaciones de psicoterapia de forma sorprendentemente realista para la época. Estos avances iniciales demostraron que ciertos aspectos del razonamiento y del lenguaje podían ser abordados por máquinas siguiendo reglas definidas.

Años 70 y 80: Avances y “inviernos” de la IA

Tras el entusiasmo inicial, la comunidad de IA descubrió que crear una “máquina inteligente general” era mucho más difícil de lo imaginado. En los años 70, la financiación y el interés bajaron drásticamente en lo que se conoce como el “invierno de la IA”: periodos donde las expectativas no cumplidas llevaron a recortes y estancamiento en la investigación. No obstante, también en esa época emergieron avances notables. Por un lado, se desarrollaron los sistemas expertos (programas diseñados para tomar decisiones basadas en reglas específicas de expertos humanos), que tuvieron éxito en campos como el diagnóstico médico o la geología durante los años 80. Por otro lado, la idea de redes neuronales artificiales resurgió: inspiradas en el cerebro humano, estas redes intentan aprender patrones a partir de ejemplos. Aunque el concepto de redes neuronales había nacido décadas antes (el perceptrón de Frank Rosenblatt en 1958 es un ejemplo temprano), fue en la década de 1980 cuando investigadores como Geoffrey Hinton impulsaron su desarrollo, sentando bases para futuros éxitos.

A finales de los 80, sin embargo, la IA volvió a enfrentar desafíos: las limitaciones computacionales y algunas decepciones en resultados llevaron a un segundo “invierno” de la IA. Muchas empresas abandonaron proyectos de inteligencia artificial al no ver retornos inmediatos. Pese a ello, se continuaron refinando técnicas y esperando mejores condiciones (más datos y mejor hardware) para que la IA floreciera.

Años 90 y 2000: Aprendizaje automático y grandes hitos

En la década de 1990, el panorama comenzó a cambiar gracias al aumento de la potencia de cómputo y la acumulación de datos. Surge con fuerza el aprendizaje automático (o machine learning), enfoque que permite a las máquinas aprender de ejemplos en lugar de ser programadas con reglas rígidas. Algoritmos como las redes neuronales multicapa, los árboles de decisión y las máquinas de vectores de soporte (SVM) demostraron ser útiles para reconocer patrones complejos en datos.

Un momento emblemático llegó en 1997 cuando la supercomputadora IBM Deep Blue derrotó al campeón mundial de ajedrez Garry Kasparov. Este hecho captó la atención mundial: por primera vez, una máquina superaba a un humano campeón en un juego considerado altamente intelectual. Aunque Deep Blue utilizó principalmente fuerza bruta de cálculo y reglas específicas, marcó un antes y un después en la percepción pública de lo que la IA podía lograr.

En los años 2000, continuaron los progresos. En 2011, IBM Watson (otro sistema de IA avanzado) ganó el concurso televisivo Jeopardy! compitiendo en conocimientos generales y lenguaje contra humanos. Watson podía procesar preguntas formuladas en lenguaje natural y buscar respuestas entre enormes colecciones de datos en segundos. También en este periodo comenzaron a aparecer asistentes virtuales en nuestros teléfonos, como Siri (introducido por Apple en 2011) y, poco después, Google Now y Cortana, llevando la IA conversacional básica al usuario común. El aprendizaje automático se consolidaba en aplicaciones prácticas, desde filtrado de spam en el correo electrónico hasta recomendaciones en plataformas digitales.

2010s: La revolución del aprendizaje profundo

La década de 2010 fue testigo de un salto cualitativo gracias al aprendizaje profundo (deep learning). Esta rama del aprendizaje automático utiliza redes neuronales profundas (con muchas capas) y se benefició enormemente de los grandes volúmenes de datos disponibles en la era de Internet, así como de la aceleración del hardware (por ejemplo, el uso de GPUs para entrenamiento). Un punto de inflexión fue en 2012 cuando un modelo de red profunda ganó la competición de reconocimiento de imágenes ImageNet con una precisión sin precedentes, demostrando el poder de estas técnicas para visión por computadora. A partir de entonces, la IA empezó a superar récords en tareas que antes eran muy difíciles: reconocimiento de voz casi al nivel humano, traducción automática mejorada, etc.

También en esta década, la IA logró hazañas impresionantes: en 2016, el sistema AlphaGo de DeepMind venció al campeón mundial de Go, un juego mucho más complejo que el ajedrez en cuanto a combinaciones posibles. Esto se logró combinando aprendizaje profundo con aprendizaje por refuerzo (una técnica de la que hablaremos en otra lección), dejando claro que las máquinas podían aprender estrategias complejas más allá de la programación manual. Otra vertiente que despegó fue la IA generativa: modelos capaces de crear contenido original. Surgieron redes generativas antagónicas (GAN) que podían generar imágenes realistas a partir de ruido, y modelos de lenguaje cada vez más sofisticados. Hacia el final de la década, OpenAI presentó GPT-2 (2019), un modelo generador de texto sorprendentemente coherente. La evolución de estos modelos de lenguaje marcaría el comienzo de una nueva era.

2020s: IA generativa y expansión masiva

Entrando en los años 2020, la inteligencia artificial dejó de ser terreno exclusivo de expertos para convertirse en una herramienta accesible a millones de personas. En 2020 OpenAI lanzó GPT-3, un modelo con mil millones de parámetros capaz de realizar tareas de lenguaje con una fluidez nunca vista, desde escribir ensayos hasta generar código. Pero el verdadero punto de inflexión en la cultura popular llegó a finales de 2022 con ChatGPT, un sistema de chat basado en GPT-3.5 (y posteriormente GPT-4) que cualquiera podía usar para tener conversaciones, obtener información o asistir en tareas creativas. ChatGPT demostró al gran público lo avanzada que estaba la IA: de pronto, hablar con una inteligencia artificial era algo normal en entornos de trabajo, educación y ocio.

Al mismo tiempo, la generación de imágenes por IA alcanzó al público general con herramientas como DALL-E (de OpenAI), Midjourney y Stable Diffusion en 2022-2023, permitiendo crear arte e imágenes a partir de texto descriptivo. Nunca antes la IA había estado tan presente en la vida cotidiana: desde algoritmos que mejoran fotografías en nuestros móviles, hasta modelos que ayudan a médicos a diagnosticar enfermedades analizando imágenes o historiales.

En 2023-2024, la tendencia ha sido integrar la IA en todo tipo de productos y servicios. Empresas de todos los tamaños buscan cómo aprovechar IA generativa para mejorar la atención al cliente, marketing, desarrollo de productos y más. Además, se empezó a hablar de la democratización de la IA, ya que las herramientas son cada vez más fáciles de usar (incluso sin saber programar) y muchas son de bajo costo o gratuitas. Sin embargo, junto con esta expansión, también surgieron debates necesarios sobre el impacto social de la IA, su regulación y ética (que abordaremos en otra lección).