Marco regulatorio de la IA (UE, USA, LATAM)

Regulación de la IA en la Unión Europea (UE) – El AI Act

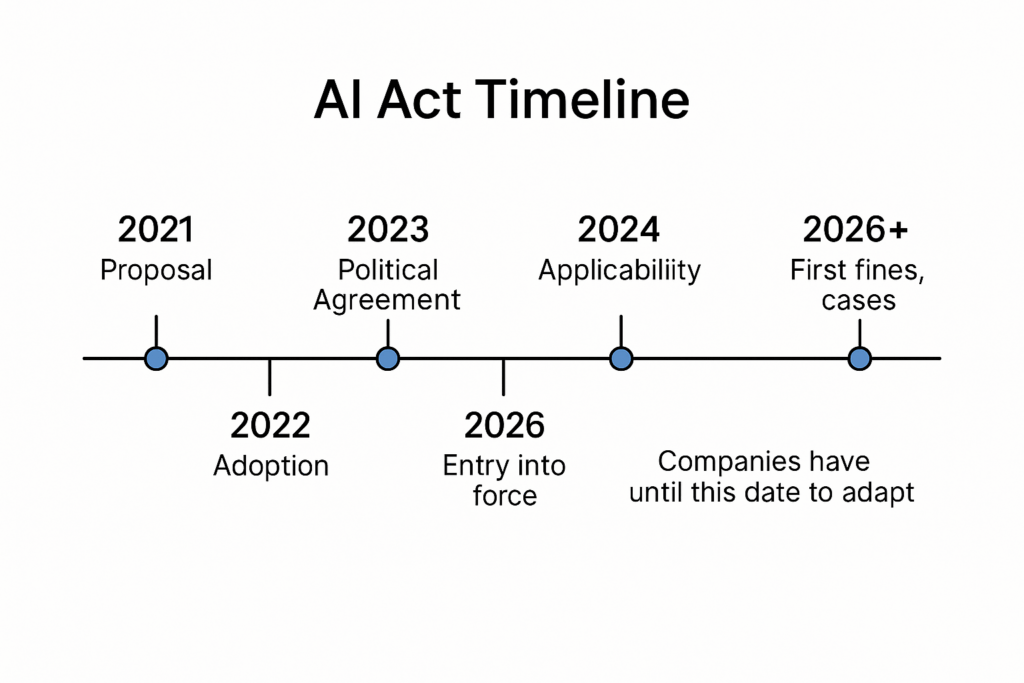

La Unión Europea está a la vanguardia en la creación de una ley integral para regular la inteligencia artificial, conocida informalmente como Ley de IA, y de forma oficial como AI Act (por sus siglas en inglés). Este marco legal fue propuesto en 2021 y tras años de negociaciones se adoptó en 2024, convirtiéndose en la primera gran regulación sobre IA en el mundo. A continuación, se explican sus puntos clave de forma sencilla:

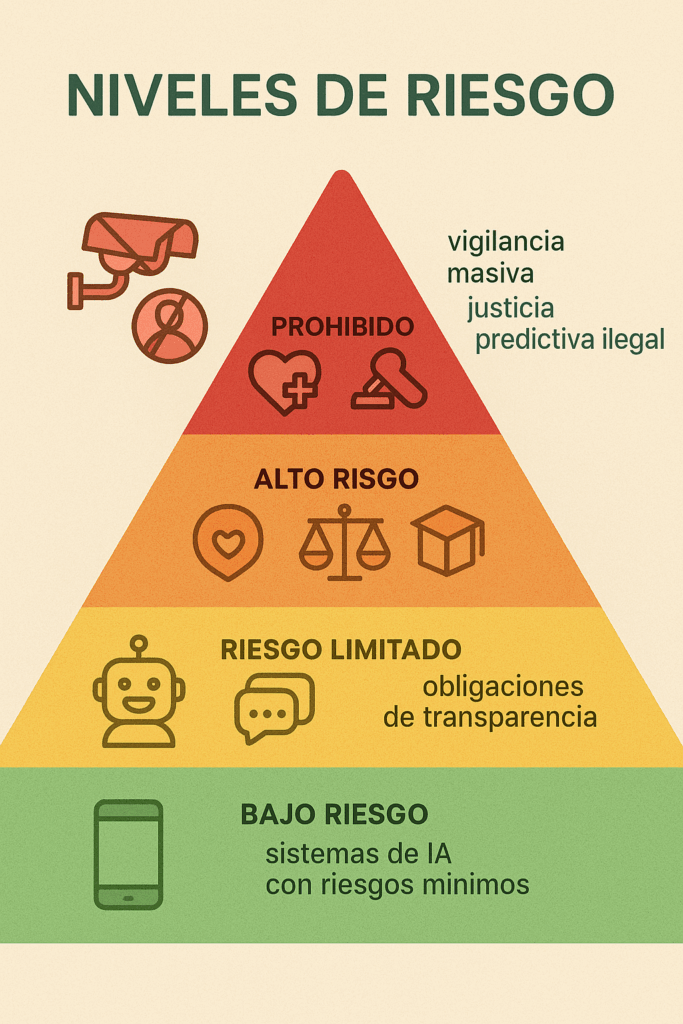

Enfoque general – basado en el riesgo:

La UE ha clasificado las aplicaciones de IA en cuatro niveles de riesgo, estableciendo prohibiciones u obligaciones según el nivel:

1- Riesgo inaceptable (prohibido):

Son usos de la IA que se consideran amenazantes para derechos fundamentales o la seguridad y por tanto están prohibidos por la ley. Aquí se incluyen, por ejemplo, sistemas de vigilancia biométrica masiva en espacios públicos (como cámaras con IA que identifiquen a todos en tiempo real, algo visto como excesiva vigilancia), o los sistemas de “score social” al estilo de un crédito social (calificar la reputación o comportamiento de las personas de forma generalizada, como se ha planteado en otros países, queda vetado en Europa). También se prohíbe emplear IA en técnicas subliminales para manipular el comportamiento de las personas de forma dañina, o usarla para explotar vulnerabilidades de grupos específicos (por ejemplo, juguetes con IA que manipulen a niños de forma peligrosa). Otro ejemplo claro de prohibición es el uso de IA para clasificar personas por características sensibles (raza, religión, orientación sexual, opiniones políticas, etc.) de manera que pueda suponer discriminación. En resumen, cualquier aplicación de IA que choque frontalmente con los valores de derechos humanos de la UE se pone en la lista negra.

2- Riesgo alto:

Son sistemas de IA que no se prohíben, porque pueden tener beneficios, pero que pueden afectar seriamente la salud, la seguridad o los derechos fundamentales de las personas si funcionan mal o se usan sin control. La UE identifica varias áreas de alto riesgo: por ejemplo, IA usada en infraestructuras críticas (red eléctrica, transporte… donde una falla podría ser grave), en educación y empleo (decidir admisiones escolares, ayudar a contratar o despedir empleados, evaluar estudiantes o trabajadores), en servicios esenciales como la asistencia sanitaria (un diagnóstico médico automatizado), en la aplicación de la ley y justicia (sistemas que ayuden a jueces o policía a tomar decisiones), o en finanzas (sistemas que evalúan créditos, puntuación crediticia). Al considerarse de alto riesgo, la ley no los prohíbe pero impone obligaciones estrictas antes y durante su despliegue. ¿Qué obligaciones? Estas IA deben pasar por evaluaciones de conformidad y gestión de riesgos antes de salir al mercado: los desarrolladores tienen que analizar qué riesgos tiene su sistema (por sesgo, por posible error, etc.) y tomar medidas para mitigarlos. Deben también documentar muy bien el funcionamiento (tener documentación técnica disponible para autoridades), garantizar cierta transparencia (que se pueda entender en términos generales qué hace la IA), asegurar supervisión humana (no dejar decisiones totalmente en manos de la máquina si son delicadas), y calidad de datos (entrenar con datos relevantes, mitigando discriminación). En pocas palabras, si tu IA entra en “alto riesgo”, tendrás que cumplir requisitos similares a obtener un sello de calidad: demostrar que es segura, equitativa y bajo control humano. Un ejemplo práctico: una empresa que quiera usar un algoritmo para preseleccionar currículums de candidatos (eso entra en empleo, alto riesgo) tendrá que realizar una auditoría del algoritmo, probar que no discrimina por género o etnia, informar a los candidatos de que se usa IA, etc.

3- Riesgo limitado (IA con requisitos específicos):

En este nivel están las IAs que no suponen un riesgo alto, pero aun así la UE cree que requieren cierta transparencia hacia el usuario. Principalmente se refiere a sistemas con los que interactuamos y podría no quedar claro que son IA, o que generan contenido potencialmente engañoso. Aquí entran ejemplos como chatbots conversacionales, asistentes virtuales comunes, y las IA generativas que crean imágenes, audio o video (deepfakes incluidos). La ley dirá que estos sistemas deben informar a las personas de su naturaleza: es decir, si estás hablando con un chatbot, tienes derecho a saber que “no es humano, es una IA”. O si una imagen o video ha sido creado por IA (y puede falsear la realidad), debe llevar una etiqueta o marca de agua indicándolo para no confundir al público. Piensa en un deepfake: la ley obligará a que cualquier deepfake claramente señalizado, a menos que se use en parodia o situaciones legales muy acotadas. También se incluyen sistemas como filtros de vídeo o audio (que imitan voces o rostros); el usuario debe ser consciente cuando un contenido ha sido manipulado por IA. En resumen, transparencia es la palabra clave en este nivel: el énfasis está en “no engañar”. No se pide una auditoría estricta como a los de alto riesgo, pero sí avisos claros. Por ejemplo, una aplicación que genere voces sintéticas deberá avisar “voz generada por computadora” en algún modo, o un asistente virtual al teléfono podría tener que presentarse diciendo “soy un agente virtual automatizado” al iniciar la llamada.

4- Riesgo mínimo o nulo:

Son aquellos sistemas de IA que no presentan un riesgo apreciable para derechos o seguridad, y por tanto quedan prácticamente fuera de la regulación (uso libre, sin requisitos especiales). Aquí la mayoría de software de IA entra: cosas como videojuegos con IA básica, filtros de spam en el email, recomendaciones de películas en una plataforma, etc. La UE los considera de bajo riesgo y no les impondrá obligaciones adicionales (más allá de las leyes generales que igualmente apliquen, claro). Esto es importante: la ley no busca frenar la innovación en IA cotidiana, solo se focaliza en los usos más sensibles. Así se evita sobrecargar con trámites a desarrollos benignos. Un desarrollador de, digamos, una app que te sugiere recetas con IA, no tendrá nuevas cargas bajo la Ley de IA porque eso se consideraría riesgo mínimo.

Fechas clave y aplicación:

La AI Act, tras su aprobación formal en 2024, entró en vigor en agosto de 2024. Sin embargo, la mayoría de sus disposiciones no serán exigibles inmediatamente; se dio un período de transición para que las empresas y Estados miembros se preparen. Se prevé que a partir de 2026 las reglas serán ya de cumplimiento obligatorio (aproximadamente dos años tras la entrada en vigor, que es el tiempo típico de adaptación en la UE). Algunas obligaciones, como prohibiciones de ciertos usos especialmente graves, pueden aplicarse algo antes, pero en general las empresas tienen ese margen para adecuar sus sistemas. Esto significa que, para 2025-2026, cualquier emprendedor que quiera ofrecer un sistema de IA en Europa debe ya estar revisando cómo encajará en estas categorías y qué necesita hacer para entonces.

Multas y enforcement (cumplimiento): Al igual que con el Reglamento General de Protección de Datos (GDPR), la UE acompaña esta ley con sanciones fuertes para disuadir incumplimientos. Las multas pueden alcanzar cifras significativas: se habla de hasta 30 o 35 millones de euros, o hasta un 6-7% de la facturación anual global de la empresa, lo que sea mayor, para las infracciones más graves (por ejemplo, si una empresa usa IA prohibida a sabiendas, o si un proveedor oculta información y pone en mercado un sistema de alto riesgo sin las garantías requeridas). Para infracciones menos graves (como no cumplir una obligación de transparencia), los porcentajes y cuantías máximas son menores, pero aun así sustanciales (por ejemplo, un 4% de facturación global para ciertas faltas). En suma, la UE quiere que la ley tenga “dientes”: si alguien la viola, puede enfrentar multas del orden de las que impone GDPR, que en casos de multinacionales pueden ser miles de millones. Además, se establecerán autoridades de supervisión en cada país (como ahora hay agencias de protección de datos, las habrá para IA) que podrán realizar inspecciones, exigir documentación de los sistemas, e incluso retirar del mercado sistemas que no cumplan y supongan riesgos.

Otras obligaciones y detalles:

- Obligaciones para proveedores de sistemas de IA genéricos o de propósito general: Esto incluye a quienes desarrollan modelos fundacionales tipo GPT, que no están diseñados para un solo fin sino que luego otros los usan para múltiples propósitos. La UE introducirá requisitos para estos proveedores, por ejemplo, que implementen medidas para evaluar y mitigar posibles riesgos (como evitar que su modelo se use para generar desinformación, gestionar el sesgo en los datos de entrenamiento, etc.), y que informen a los usuarios si su modelo puede generar contenido protegido por copyright o cosas así. También deberán registrar ciertos sistemas en una base de datos de la UE cuando sean de alto riesgo.

- Marcado CE para IA: Se espera que los sistemas de IA de alto riesgo tengan que llevar un marcado CE(Conformité Européenne), similar al de juguetes o equipos electrónicos, indicando que cumplen con la regulación. Esto implicará que antes de salir al mercado, un evaluador externo o el propio desarrollador (según el caso) verifique el cumplimiento de todos los requisitos técnicos de la ley.

- Responsabilidad civil: Paralelamente al AI Act, la UE trabaja en ajustar leyes de responsabilidad civil para que si una IA causa daño (por ejemplo, un coche autónomo provoca un accidente por un fallo del algoritmo), sea más claro quién responde y cómo puede la víctima reclamar. Esto complementa el marco, aunque está en discusión aparte.

- IA en la administración pública: La ley también contempla que las autoridades evalúen los sistemas de IA que usen internamente, especialmente si afectan a ciudadanos (por ejemplo, un sistema que reparta prestaciones o detecte fraudes).

- Fomento de la “IA de confianza”: Aunque es una ley restrictiva en ciertos puntos, la UE busca con ella generar confianza en la IA, para que la ciudadanía y las empresas se animen a usarla sabiendo que hay garantías. Por eso acompaña el reglamento con iniciativas de apoyo a la innovación responsable, sandboxes regulatorios (entornos de prueba supervisados para IA innovadora) y formación en ética de la IA, etc.

En resumen, el marco regulatorio europeo es rígido en cuanto a proteger valores fundamentales: prohíbe los usos más peligrosos, domestica los usos de alto riesgo con normas de seguridad, exige transparencia en otros, y deja en paz lo trivial. Todo emprendedor o empresa que aspire a operar en Europa con IA deberá familiarizarse con estas categorías y preparar la conformidad de sus productos.

Panorama regulatorio en Estados Unidos: enfoque flexible y mosaico de iniciativas

Contrariamente al enfoque unificado de la UE, Estados Unidos no cuenta aún (en 2025) con una ley federal única que regule la inteligencia artificial de manera integral. En su lugar, se está desarrollando un mosaico de iniciativas a distintos niveles:

- Enfoque de “soft law” federal: A nivel del gobierno federal, la preferencia hasta ahora ha sido emitir guías, principios y fomentar la autorregulación, más que imponer leyes estrictas. Un ejemplo clave es el “Blueprint for an AI Bill of Rights” (Plan para una Carta de Derechos de la IA) publicado por la Casa Blanca en 2022. Este documento no es una ley, sino un conjunto de principios éticos que deberían guiar el desarrollo y uso de la IA: habla de proteger a la gente de algoritmos inseguros, evitar sesgos discriminatorios, garantizar privacidad de los datos, explicar las decisiones de IA de forma transparente, y ofrecer opciones humanas (por ejemplo, la posibilidad de dirigirte a una persona real si un algoritmo está manejando algo que te afecta). Aunque inspirador, no es vinculante legalmente.Otro pilar es el Marco de Gestión de Riesgos de IA del NIST (NIST AI Risk Management Framework), publicado en enero de 2023. El NIST (Instituto Nacional de Estándares y Tecnología) es una agencia técnica que desarrolló este marco con participación de industria y academia. Sirve como guía voluntaria para que las empresas identifiquen y mitiguen riesgos en sus sistemas de IA (riesgos de seguridad, de sesgo, de falta de fiabilidad, etc.). Muchas compañías en EE.UU. lo están adoptando como buena práctica, e incluso algunos reguladores podrían tomarlo como referencia, pero de nuevo, no es ley, es voluntario.Además, ha habido órdenes ejecutivas del Presidente enfocadas en IA: por ejemplo, en octubre de 2023 (bajo la administración Biden) se firmó una orden ejecutiva para asegurar un desarrollo seguro de la IA, pidiendo a agencias que establecieran estándares en distintos sectores (seguridad nacional, sanidad, educación) e iniciando un requisito de que modelos de IA muy potentes pasen por evaluaciones de seguridad (similares a pruebas antes de su lanzamiento). Sin embargo, una orden ejecutiva marca directrices dentro del gobierno y para empresas contratistas, no crea obligaciones generales para todas las empresas como lo haría una ley del Congreso.

- Agencias federales usando leyes existentes: En EE.UU., aunque no haya una “Ley de IA”, las autoridades están aplicando leyes vigentes a los problemas que surgen con IA. Por ejemplo, la Comisión Federal de Comercio (FTC) ha advertido que si una empresa hace afirmaciones falsas o engañosas sobre sus productos de IA, puede considerarse publicidad engañosa bajo las leyes de consumo. O si un algoritmo ocasiona discriminación (por ejemplo en otorgar créditos o en selección de personal), podría violar leyes de derechos civiles existentes (como la Ley de Igualdad de Oportunidades de Crédito, o leyes contra discriminación laboral). En 2023, las agencias FTC, el Departamento de Justicia, la EEOC (igualdad de empleo) y la CFPB (protección financiera del consumidor)lanzaron un comunicado conjunto diciendo básicamente: “Aunque la IA sea nueva, nadie está por encima de la ley: si su uso resulta en violaciones a derechos del público, actuaremos con las leyes que tengamos.” Esto indica que, a falta de regulación específica, EE.UU. usa sus herramientas legales generales para casos de IA (antimonopolio si una gran empresa abusa de IA para dominar mercado, seguridad de productos, responsabilidades por daños, etc.).

- Iniciativas legislativas en el Congreso (federales): El debate político sobre regular IA está en marcha. Varios senadores y representantes han propuesto proyectos de ley, aunque ninguno ha pasado todavía en 2024-2025. Entre ellos:

- Algorithmic Accountability Act: un proyecto que se introdujo por primera vez en 2019 y revisado luego, que buscaba obligar a las empresas a realizar evaluaciones de impacto algorítmico en sistemas de IA usados en decisiones importantes (empleo, crédito, etc.), informando de posibles sesgos o riesgos. No avanzó hasta convertirse en ley, pero partes de esa idea resuenan en otras propuestas.

- Crear una agencia federal de IA: Hay discusiones sobre si se necesita un organismo regulador específico para IA (así como existe la FDA para fármacos, por ejemplo). Algunas propuestas sugieren fundar una comisión o agencia que certifique y supervise IA de alto riesgo. Esto aún está en fase de debate, con opiniones divididas (algunos temen crear burocracia que frene la innovación, otros creen que sin un órgano especializado será difícil controlar las IA más avanzadas).

- Framework de Schumer: A mediados de 2023, el líder de la mayoría en el Senado, Chuck Schumer, presentó un “marco” para legislación de IA denominado SAFE Innovation (Innovación Segura, por sus siglas en inglés: Seguridad, Rendición de cuentas, Fundamentos, Explicabilidad). Este marco no es una ley en sí, sino un plan de por dónde deberían ir las futuras leyes: asegurarse de que EEUU lidera en IA pero de forma responsable. Bajo ese impulso, en fines de 2023 y 2024 se realizaron en el Congreso varias audiencias y foros con expertos y CEOs de tecnológicas para educar a los legisladores sobre IA. Es probable que de aquí surjan proyectos de ley más concretos.

- Leyes sectoriales: También se están considerando actualizaciones a leyes de seguridad de productos, o específicas para vehículos autónomos, etc., que incluyan requisitos de IA. Por ejemplo, en transportes autónomos se discute cómo asegurar que los algoritmos de pilotaje cumplan ciertos estándares antes de aprobar coches sin conductor a gran escala.

A día de hoy, no hay fecha cierta para la aprobación de una ley federal de IA. La dinámica política en EE.UU. hace que normalmente regulen tecnologías de forma más lenta que Europa, prefiriendo ver cómo evoluciona la industria. Es posible que en los próximos años emerja alguna ley centrada en transparencia de algoritmos o protección frente a sesgos, pero mientras tanto, el panorama es de múltiples iniciativas fragmentadas. - Regulaciones a nivel estatal: Mientras el gobierno federal debate, muchos estados de EE.UU. han tomado la delantera con sus propias leyes o al menos intentos. A finales de 2024, más de la mitad de los estados habían introducido algún proyecto de ley relacionado con IA, y decenas de ellos aprobaron medidas. Pero estas varían muchísimo en alcance:

- Algunos estados se han centrado en IA en la contratación y empleo. Por ejemplo, Illinois fue pionero con una ley que regula el uso de IA en entrevistas de trabajo grabadas en vídeo: requiere informar al aspirante, obtener su consentimiento y limitar cómo se comparten esos análisis. Nueva York (ciudad) aprobó una ordenanza (Nueva York Ley Local 144) que obligará a empresas que usen sistemas automatizados para decidir contrataciones o promociones a someter esos sistemas a auditorías anuales de sesgo y a notificar a candidatos sobre su uso. Esto entró en vigor (tras retrasos) en 2023 y marca un precedente importante.

- Otros estados han abordado el reconocimiento facial y la vigilancia. Por ejemplo, Massachusetts y California debatieron moratorias o restricciones al uso de reconocimiento facial por la policía a nivel estatal. Estados como Washington impusieron ya en 2020 que las agencias estatales solo pueden usar sistemas de reconocimiento facial tras aprobarse una ley especial y con supervisión humana, etc. A nivel de ciudades, previo a la ola de IA, lugares como San Francisco habían prohibido uso de reconocimiento facial por cuerpos policiales municipales.

- Varios estados han creado comisiones o grupos de trabajo sobre IA, para estudiar su impacto y proponer regulaciones. Por ejemplo, California estableció un grupo asesor en IA en 2023 y discute una posible “Carta de Derechos de los algoritmos” a nivel estatal.

- También hay leyes estatales sobre deepfakes: Texas y California aprobaron restricciones al uso de deepfakes en contexto electoral (prohibiendo difundir videos falsos de candidatos cerca de las elecciones) o pornográficos (criminalizando deepfakes pornográficos no consentidos).

- En ámbitos como seguros y finanzas, algunos estados vigilan que el uso de IA no viole sus regulaciones sectoriales y han emitido guías. Por ejemplo, Colorado en seguros exige transparencia si se usan algoritmos que afecten a clientes.

El resultado es un panorama fragmentado: las obligaciones para una empresa que usa IA pueden variar según el estado. Esto preocupa a las compañías, que preferirían una ley federal homogénea. De hecho, hay debates sobre si las leyes estatales de IA podrían quedar “preempted” (anuladas) si el Congreso federal legisla algo general en el futuro, lo cual crea incertidumbre.

En síntesis, la aproximación estadounidense por ahora es más laxa y dirigida por la industria que la europea. Prima la innovación: se anima a las empresas a desarrollarse con libertad, confiando en que sigan lineamientos voluntarios y en aplicar leyes de siempre para frenar abusos caso a caso. Para un emprendedor o empresa, esto significa menos trabas inmediatas que en la UE, pero también una posible falta de claridad: hay que estar pendiente de varias fuentes (guías federales, posibles leyes estatales, regulaciones sectoriales) para cumplir con lo necesario. El consenso en EE.UU. aún se está formando; es crucial monitorear, porque en cualquier momento alguna crisis (por ejemplo, un escándalo de IA causando daño) podría precipitar la aprobación de una ley específica.

Situación en Latinoamérica: primeros pasos regulatorios y marcos existentes

En Latinoamérica, el marco regulatorio de IA está en una fase inicial. A diferencia de la UE (ya con ley) o EE.UU. (con mucha discusión pública), en América Latina muchos países aún no tienen leyes específicas de IA aprobadas. Sin embargo, esto no significa que no estén haciendo nada: hay proyectos de ley en discusión, estrategias nacionales de IA y marcos legales de datos que sientan las bases. Veamos el panorama regional:

- Inspiración internacional: Varios países latinos están tomando como referencia los desarrollos de fuera. La Unión Europea sirve de modelo para algunos proyectos de ley locales que copian la idea de los niveles de riesgo y las prohibiciones. También la UNESCO ha influido: en 2021 publicó una Recomendación sobre la Ética de la IA, y desde 2023 ha trabajado con más de 50 países (incluyendo Brasil, México, Costa Rica, Uruguay, etc.) para evaluar su preparación regulatoria conforme a esos principios éticos. Asimismo, países de la región que son miembros de la OCDE (Argentina, Brasil, Colombia, Costa Rica, Perú) han suscrito los Principios de IA de la OCDE, que abogan por una IA centrada en el ser humano, transparente y responsable. En 2019, Argentina, Brasil y México firmaron también los Principios del G20 sobre IA, similares en espíritu. Todo esto para decir: Latinoamérica no regula en el vacío, se apoya en marcos globales de ética y derechos, y especialmente el modelo europeo técnico está siendo adaptado.

- Países que han legislado o están cerca de hacerlo: Hasta 2025 ningún país latinoamericano ha promulgado una ley integral de IA plenamente en vigor, pero el caso más avanzado es Brasil. Brasil inició temprano, ya en 2020 se debatía un proyecto inicial. En 2023-2024, el Senado brasileño aprobó un proyecto de ley de IA que luego debe pasar por la Cámara de Diputados. Este proyecto brasileño es bastante completo: propone establecer normas de gobernanza responsable de sistemas de IA, con una estructura muy alineada a la UE. Incluye definir categorías de riesgo para IA (y prohibir aquellas de riesgo extremo que dañen a las personas), exigir evaluaciones de impacto algorítmico para sistemas de alto riesgo, garantizar principios éticos (derechos humanos, no discriminación, etc.), dar a los ciudadanos derechos como obtener explicaciones o intervención humana en decisiones automatizadas, y hasta crear una autoridad reguladora nacional de IA que supervise el cumplimiento. También prevé un régimen de responsabilidad objetiva: si un sistema de IA de alto riesgo causa un daño, el proveedor u operador sería directamente responsable. Es decir, Brasil se encamina a una ley robusta (si finalmente se aprueba en 2025) que sería pionera en la región.

Otros países con legislación en trámite:- Chile: En 2023 se introdujo el Proyecto de Ley Nº 16821-19, enfocado en IA. Chile propone también un enfoque de riesgo: definir categorías, prohibir IA inaceptable (similar a UE) y controlar la de alto riesgo. Además, planea la creación de una Comisión Nacional de IA que, de aprobarse la ley, se encargaría de clasificar el riesgo de los sistemas de IA que se usen en Chile, autorizar los de mayor riesgo, y proponer mejoras regulatorias continuamente. Es una idea interesante: un ente que valida cada sistema antes de que se despliegue ampliamente. Esta comisión sería una especie de “agencia de IA” chilena.

- Argentina: Ha habido varios proyectos. Uno notable de 2023 (expediente 2505-D-2023) proponía un marco con clasificación de sistemas de IA desde riesgo inaceptable hasta insignificante, siguiendo la estela europea. También otro proyecto en 2024 (3900-D-2024) plantea crear un Observatorio Federal de IA para monitorear el desarrollo de la IA en el país y asesorar en política pública. De momento, ninguno se ha convertido en ley, pero indican un interés legislativo. Argentina además tiene pendiente modernizar su ley de protección de datos personales, lo cual también impacta en IA.

- México: Se discuten propuestas como la Ley para la Regulación Ética de la Inteligencia Artificial(presentada posiblemente en 2023-2024). Esta iniciativa mexicana contemplaría un enfoque basado en riesgo, categorías de impacto y la creación de un Consejo Mexicano de Ética en IA y Robótica (CMETIAR) para velar por prácticas éticas. Además, en el Senado mexicano ha habido foros y proyectos sobre IA responsable, pero hasta ahora sin aterrizar en una ley concreta.

- Colombia: Si bien Colombia no tiene un proyecto de ley avanzado centrado en regulación dura, sí presentó en 2023 un proyecto (por la Cámara de Representantes) para definir y regular la IA ajustada a estándares de derechos humanos. Colombia por ahora ha priorizado desarrollar una Hoja de Ruta de IA Ética y sostenible (una política pública) más que una ley con prohibiciones. Es decir, trabaja en fomentar la IA pero con lineamientos éticos, sin legislarla fuertemente todavía.

- Uruguay y Costa Rica: Son países destacados en estrategias nacionales de IA. Uruguay tiene una política digital avanzada y participa en proyectos piloto con UNESCO sobre evaluación de preparación en IA. Costa Rica presentó en 2022 un proyecto de ley (no aprobado aún) para regular la IA en aspectos de principio ético, además de tener su Estrategia Nacional de IA.

Cabe resaltar que ninguno de estos proyectos es ley vigente aún. Brasil está más cerca, y puede que en 2025 sea el primero en promulgar. - Marcos de datos y protección de información: Una parte crucial del entorno regulatorio existente en Latam son las leyes de protección de datos personales. Muchos países de la región ya cuentan con ellas (inspiradas por la antigua Directiva europea o por el GDPR). Por ejemplo, Brasil tiene la LGPD (Ley General de Protección de Datos) en vigor desde 2020; México tiene su Ley Federal de Protección de Datos desde 2010; Argentina tiene una ley de datos del año 2000 (y busca actualizarla); Chile, Colombia, Perú, Uruguay etc. también cuentan con leyes de privacidad. ¿Por qué importan para IA? Porque cualquier sistema de IA que trate datos personales en estos países debe cumplir esas normas: obtener consentimiento o tener base legal para usar datos, protegerlos, permitir a la persona acceder, rectificar o borrar sus datos, etc. Esto ya pone límites a ciertos usos de IA (por ejemplo, entrenar un modelo con datos personales sin permiso podría ser ilegal). Además, algunas autoridades locales han aplicado estas leyes a casos de IA: notablemente, en 2023 Brasil utilizó la LGPD para frenar temporalmente el uso de datos personales en entrenar modelos de IA de empresas tecnológicas, preocupados por la privacidad.También existen leyes sectoriales que, sin mencionar “IA”, tocan su uso. Por ejemplo, leyes de defensa del consumidor (que podrían usarse si un producto con IA es engañoso), leyes contra discriminación (aplicables si un algoritmo da trato injusto), o regulación financiera (si un banco usa IA para decisiones, los reguladores bancarios pueden supervisar que no vulnere reglas prudenciales).

- Estrategias nacionales e instituciones: Muchos países han optado primero por desarrollar Planes o Estrategias Nacionales de IA antes que leyes. Estos documentos establecen visiones de cómo fomentar IA, promover investigación, capacitar talento y también a veces esbozan principios éticos. Por ejemplo, Brasil tiene su Plan Brasileño de IA 2024-2028, con inversión prevista y acciones concretas (incluyendo la creación de un Centro Nacional de Transparencia Algorítmica e IA Confiable, y un Observatorio Brasileño de IA para seguimiento). Chile, Uruguay y otros también tienen estrategias que incluyen capítulos sobre ética y regulación. Estas estrategias son políticas públicas, no regulaciones obligatorias, pero preparan el terreno e identifican qué cambios legales podrían hacer falta a futuro.En términos de instituciones, además de los observatorios y comisiones mencionados (propuestos en Argentina, creados en Brasil vía plan, propuestos en Chile y México), la región aún carece de autoridades regulatorias exclusivas de IA. Es decir, no hay “Superintendencia de IA” todavía en ningún país. Por ahora, las agencias de protección de datos o de telecomunicaciones a veces absorben temas de algoritmos, o secretarías de ciencia y tecnología lideran los esfuerzos. Es de esperar que si las leyes en trámite se aprueban, se creen nuevos organismos o se amplíe el mandato de los existentes para fiscalizar la IA.

- Diferencias dentro de la región: Latinoamérica no es monolítica en este tema. Algunos países como Brasil, Chile, Uruguay están claramente liderando en preparación digital y conciencia sobre IA (como indica un Índice Latinoamericano de IA que elaboró la CEPAL, donde esos países puntuaron más alto en adopción y políticas de IA). Otros países más pequeños o con menos recursos digitales quizá tengan la IA menos priorizada, centrándose más en cerrar brechas de conectividad primero. También influye la estabilidad política y la agenda legislativa de cada país. Por ejemplo, Brasil con su potente sector tecnológico y ser sede de un G20 ha empujado fuerte en IA, mientras países centroamericanos o caribeños tienen hasta ahora poca actividad normativa en IA.

En general, Latinoamérica enfrenta el reto de equilibrar: quiere aprovechar la IA para el desarrollo económico (muchos ven la IA como oportunidad de crecimiento e innovación), pero a la vez hay consciencia de sus riesgos en sociedades desiguales. Por eso el discurso suele ser “IA ética y con inclusión”. Las diferencias con Europa y EE.UU. las abordaremos en la sección siguiente, pero se puede adelantar que Latinoamérica tiende a seguir estándares internacionales en vez de inventar un camino totalmente propio, y sus ritmos de legislación son más lentos, en parte esperando ver qué funciona en otros lugares y adaptar las soluciones.

Diferencias entre las regiones (UE, EE.UU. y Latinoamérica) en regulación de IA

Cada región está tomando una aproximación distinta frente a la IA, fruto de sus contextos legales y prioridades. Comparémoslas en los puntos clave:

- Filosofía regulatoria: La UE adopta el principio de precaución y protección. Quiere regular temprano y con detalle para evitar daños y ganarse la confianza ciudadana. Su cultura legal favorece los derechos fundamentales (privacidad, no discriminación) y por ello legisla para garantizarlos frente a la IA. En cambio, Estados Unidossigue una filosofía de innovación primero: prefiere no imponer barreras iniciales para no frenar el avance tecnológico, confiando en la autorregulación y en castigar abusos solo cuando ocurran mediante leyes generales o acciones judiciales. Existe un temor en EE.UU. de que una regulación excesiva mate la competitividad (quieren seguir liderando en IA globalmente). Latinoamérica, por su parte, muestra una posición intermedia y dependiente: no quiere quedarse atrás en innovación (muchos países buscan desarrollar industrias de IA locales), pero también tienen sociedades sensibles a desigualdades y abusos, por lo que hay simpatía hacia reglas éticas. Sin embargo, la mayoría de países latinos no han saltado a regular duro aún; parecen observar qué hacen los grandes (UE/EE.UU.) para luego adaptar, mezclando lo mejor de ambos enfoques.

- Existencia (o no) de ley marco integral: La UE ya la tiene (el AI Act), EE.UU. no la tiene y quizá tarde en tenerla, Latam: ningún país la tiene aún, pero Brasil y otros están en camino. Esto significa que en Europa habrá un terreno común obligatorio en todos los países miembros, mientras que en EE.UU. y Latam ahora mismo cada estado o país puede tener reglas distintas o ninguna. Por ejemplo, un producto de IA en Europa sabrá exactamente a qué atenerse por la ley europea, mientras que en América, depende: en California puede enfrentarse a ciertas obligaciones que en Alabama no existen, o una empresa en Brasil pronto podría tener requerimientos que en Argentina aún no. Esta uniformidad vs diversidad es una diferencia práctica enorme.

- Áreas de foco: La UE abarca todas las IA en su regulación, con un enfoque horizontal (salvo excepciones militares, etc.). EE.UU. de momento actúa más por verticales: es decir, si regula algo, suele ser en un sector concreto (ej. coches autónomos, o IA médica vía la FDA, o deepfakes en elecciones). También EE.UU. tiene mucho foco en temas de competencia geopolítica: no querrán regulaciones que los dejen atrás frente a China. Europa en cambio enfatiza la ética universal más allá de la carrera tecnológica. En Latinoamérica, algunos países siguen el modelo horizontal tipo UE (los proyectos de ley amplios de Brasil, Chile, Argentina cubren cualquier IA según su riesgo), mientras que otros pueden empezar por áreas más específicas si surge un problema (por ejemplo, no sería raro que antes de una ley general, un país apruebe algo sobre, digamos, deepfakes en pornografía no consentida, porque es un asunto que preocupa localmente).

- Rigidez vs flexibilidad: La regulación europea es prescriptiva: lista de obligaciones bien definidas, multas cuantiosas, etc. EE.UU. confía en marcos flexibles (recomendaciones NIST, etc.), lo que da más libertad a empresas para decidir cómo gestionar riesgos. Latinoamérica podría inclinarse a una flexibilidad mayor en implementación, incluso en leyes propuestas. Por ejemplo, el proyecto brasileño aunque es exhaustivo, contempla que muchos detalles se dejen al autorreglamento del sector y que la autoridad promueva cumplimiento más que sancionar de entrada; es decir, busca cierto equilibrio. En ejecución, también la capacidad de enforcement (hacer cumplir) difiere: Europa tiene experiencia con GDPR multando a gigantes tecnológicos; en Latinoamérica las agencias de datos existen pero con menos recursos, y en IA sería similar: habrá que dotarlas de presupuesto y personal especializado para fiscalizar IA, lo cual tardará.

- Protección del consumidor y del ciudadano: En UE, el ciudadano es el centro: si una IA te afecta, tienes derechos claros. En EE.UU., el consumidor tiene protección a través de poder reclamar si algo sale mal (vía demandas legales), pero no tantos derechos preventivos (por ejemplo, en Europa tienes derecho a no ser sujeto a decisiones totalmente automatizadas en ciertos casos bajo GDPR, en EE.UU. no hay tal derecho explícito). En Latam, muchos países tienen constituciones o leyes que protegen derechos a la privacidad, honra, etc., que podrían invocarse contra usos dañinos de IA caso por caso, pero no hay aún la especificidad de “derechos digitales” o “derechos algorítmicos” como se discute en Europa. Sin embargo, podría llegar: países como Brasil en su proyecto de ley enumeran derechos de los usuarios de IA (explicación, apelación, etc.), similares a Europa.

- Entorno empresarial: Para una empresa de IA, Europa traerá más carga administrativa (evaluaciones, documentación, quizá contratar expertos en cumplimiento normativo). En EE.UU., a corto plazo, es más libre pero hay la incertidumbre de posibles litigios (el sistema estadounidense es litigioso: si tu IA causa un daño, es posible una demanda colectiva, etc., lo que obliga a las empresas a cuidarse pero por iniciativa propia, sin checklist claro). En Latam, por ahora hay menos riesgo regulatorio inmediato, pero las empresas que operen internacionalmente igual deben cumplir GDPR si tratan con datos europeos, etc. Además, con el tiempo tendrán que adaptarse a leyes locales que surjan; posiblemente más fragmentadas si cada país latino saca la suya. Esto puede ser desafiante para startups regionales que quieran escalar en varios países.

- Cultura y percepción pública: Interesantemente, las sociedades también difieren. En Europa, tras escándalos como Cambridge Analytica, hay bastante recelo público y exigencia de control sobre tecnología; eso apoya el mandato regulatorio. En EE.UU., la población valora la innovación y muchas veces la regula solo cuando ve problemas tangibles (ej.: hay preocupación por deepfakes o por bias en decisiones de IA tras casos mediáticos, pero también hay fascinación por las nuevas herramientas). En Latinoamérica, según encuestas, mucha gente apoya que la IA sea regulada antes de que cause desigualdades (por la experiencia con redes sociales, noticias falsas, etc.). Pero también existe el riesgo de “dependencia tecnológica”: muchos países importan las soluciones de IA de fuera (UE, EE.UU., China), entonces se sienten entre simplemente adoptar y aprovechar, o tratar de regular algo que quizás ni producen localmente. Este dilema puede hacer que algunos gobiernos piensen: “Si regulo muy fuerte, ¿no espantaré inversión o me quedaré sin acceso a X herramienta?”. Por eso a veces en Latam se ha optado por marcos suaves primero.

En resumen, podríamos decir:

- Europa: Normas claras, estrictas y comunes en todo el continente; enfoque precautorio, ciudadanía protegida, potencial impacto en costes para empresas pero se busca armonización.

- EE.UU.: Sin norma unificada todavía, enfoque reactivo y descentralizado (estados actuando); énfasis en no frenar la innovación; empresas con más libertad pero deben navegar un posible “parche” regulatorio diverso.

- Latinoamérica: En construcción, mirando modelos externos; algunos seguirán a la UE con variaciones locales, otros pueden esperar; mientras tanto, se apoyan en leyes de datos y principios éticos generales; la implementación será un desafío dado recursos limitados, pero hay voluntad de no quedar fuera del debate global.

Para cualquier emprendedor o profesional, entender estas diferencias es vital: el cumplimiento en un mercado no garantiza estar alineado en otro, y habrá que adaptar estrategias según dónde operes.

¿Qué debe saber un emprendedor, desarrollador o agencia para cumplir con las leyes de IA?

Dado este panorama regulatorio, quienes trabajan con IA (emprendiendo un producto, desarrollando una solución o implementando IA en una empresa/agencia) deben tomar acciones proactivas para cumplir con las normativas emergentes. Algunas recomendaciones y conocimientos clave son:

- Identifica las leyes aplicables según tu mercado: Lo primero es mapear dónde ofreces tu producto o servicio de IA y qué regulación está vigente o llegará pronto allí. Si operas en la UE o planeas tener usuarios allí, el AI Act europeo será ineludible: debes averiguar si tu sistema cae en alto riesgo, etc., y prepararte para sus exigencias. Si estás en EE.UU., mantente al día de leyes estatales relevantes: por ejemplo, si tu app usa reconocimiento facial, ¿hay alguna prohibición en X estado? Si tu herramienta filtra CVs, ¿tienes que hacer auditorías de sesgo por la ley de Nueva York? En Latinoamérica, vigila los países pioneros: si Brasil aprueba su ley, ¿afecta a tu negocio? Además, siempre ten en cuenta las leyes de privacidad de datos en cualquier región donde manejes datos personales. La protección de datos (como GDPR en Europa, LGPD en Brasil, etc.) es ya una realidad y suele implicar obligaciones de consentimiento, seguridad, minimización de datos, etc., que aplican a la IA cuando entrenas modelos con datos personales o cuando tu servicio procesa información de usuarios.

- Clasifica tu sistema de IA por nivel de riesgo: Incluso si tu país no lo exige formalmente todavía, es útil hacer un análisis interno del riesgo que supone tu IA. Pregúntate: ¿Mi sistema toma decisiones automatizadas que pueden afectar significativamente a personas (empleo, salud, finanzas, libertad)? ¿Está en un contexto crítico de seguridad? ¿Interactúa directamente con usuarios y podría engañarlos si no aviso que es una máquina? Según la respuesta, ubica tu IA en una categoría tipo la europea (alto riesgo, medio, bajo). Esto te dará una pauta de cuán estricto debes ser contigo mismo en cuanto a controles. Por ejemplo, un emprendimiento que desarrolla un software para diagnósticos médicos con IA debería asumirse “alto riesgo” y desde ya implementar las medidas robustas de validación clínica, transparencia y control humano, porque esas mismas serán exigidas por reguladores (sea por un futuro AI Act, sea por autoridades sanitarias). En cambio, si tienes una IA que hace recomendaciones de música, el riesgo es bajo pero igualmente considera alguna transparencia (por cortesía con el usuario). Adelantarse a clasificar y abordar riesgos hará la adaptación a cualquier ley mucho más sencilla cuando llegue.

- Implementa desde el diseño principios de “IA ética” y “cumplimiento by design”: Esto significa integrar en el proceso de desarrollo consideraciones legales y éticas. Algunos concretos:

- Transparencia y explicabilidad: Prepárate para explicar qué hace tu IA y por qué. Documenta los criterios de tu modelo: si es un modelo de caja negra difícil de explicar matemáticamente, al menos proporciona a los usuarios una explicación comprensible de los factores que considera. Por ejemplo, si tu IA rechaza un crédito, debes poder comunicar al cliente las razones principales (ingresos insuficientes, historial crediticio, etc.) de forma clara. Empieza a construir esa funcionalidad de explicación, bien sea a través de métricas interpretables o mensajes predefinidos. Igualmente, etiqueta claramente las interacciones de tu IA: si un chatbot habla con alguien en tu web, haz que se identifique como asistente virtual. Si generas imágenes o textos automáticamente, considera marcas de agua o notas “Generado por IA” en algún lado. Esto no solo cumple con posibles leyes (como las de transparencia de la UE), sino que mejora la confianza del usuario.

- Gobernanza de datos y privacidad: Asegúrate de manejar correctamente los datos que usas para entrenar y operar tu IA. Obtén los consentimientos necesarios de usuarios si vas a utilizar sus datos para entrenar algoritmos. Si utilizas datos públicos, revisa que no infrinjas derechos (copyright, privacidad). Aplica técnicas de anonimización o seudonimización si posibles. Establece políticas de retención de datos (no guardes datos personales más tiempo del necesario). Y sé transparente en tus políticas de privacidadexplicando si usas IA y cómo. Recuerda que leyes como GDPR dan a las personas derecho a oponerse a usos automatizados de sus datos; facilita vías para que ejerzan sus derechos (acceso, borrado de sus datos, etc.).

- No discriminación y equidad: Desde la fase de desarrollo, haz pruebas de sesgo en tus modelos. Verifica si tu IA trata de forma injusta a algún grupo (por ejemplo, un algoritmo de selección de personal que siempre favorezca a un género sobre otro u ofrezca un servicio peor a gente de cierta región). Si detectas sesgos, ajusta los datos o el algoritmo (existen técnicas de fairness para esto). Documenta estas pruebas; pueden servirte como evidencia de diligencia debida ante reguladores o clientes corporativos. En algunos casos (como herramientas de recursos humanos en NY), estas auditorías de sesgo ya son requeridas. Incluso si no lo son donde operas, demostrará responsabilidad y te preparará para un futuro en que posiblemente lo exijan.

- Seguridad y calidad: Incorpora medidas de seguridad para que tu IA no sea manipulable o fácilmente hackeable. Por ejemplo, proteger modelos contra inputs adversarios (ciertos pixeles que engañan a una IA visual) es un campo en desarrollo, pero ve considerando cómo blindar tu sistema. También incluye validaciones para evitar outputs peligrosos: si tienes un chatbot público, piensa en moderación de contenido (que no acabe dando consejos dañinos, etc.). Todas estas precauciones harán tu producto más robusto y cumplen con el espíritu de muchas regulaciones de “garantizar que la IA es confiable”.

- Transparencia y explicabilidad: Prepárate para explicar qué hace tu IA y por qué. Documenta los criterios de tu modelo: si es un modelo de caja negra difícil de explicar matemáticamente, al menos proporciona a los usuarios una explicación comprensible de los factores que considera. Por ejemplo, si tu IA rechaza un crédito, debes poder comunicar al cliente las razones principales (ingresos insuficientes, historial crediticio, etc.) de forma clara. Empieza a construir esa funcionalidad de explicación, bien sea a través de métricas interpretables o mensajes predefinidos. Igualmente, etiqueta claramente las interacciones de tu IA: si un chatbot habla con alguien en tu web, haz que se identifique como asistente virtual. Si generas imágenes o textos automáticamente, considera marcas de agua o notas “Generado por IA” en algún lado. Esto no solo cumple con posibles leyes (como las de transparencia de la UE), sino que mejora la confianza del usuario.

- Mantén documentación y registros: Un consejo práctico para cumplimiento es documentar todo el ciclo de vidade tu sistema de IA. Crea un expediente donde conste: qué datos usaste para entrenar (origen, características, fecha), cómo entrenaste (algoritmo, parámetros), qué resultados de prueba obtuviste (exactitud, errores encontrados), qué medidas de mitigación aplicaste, y cómo realizas el mantenimiento. También guarda registros de las decisiones que toma la IA en producción, al menos para los casos sensibles, de modo que puedas auditarlos si algo sale mal. Por ejemplo, si tienes un IA que califica solicitudes de algo, logea esas calificaciones y los factores, de forma que si un cliente se queja, puedas revisar qué ocurrió en su caso. Esta documentación servirá para auto-evaluar tu cumplimiento, para mostrarla a autoridades si lo piden (la UE requerirá que esté disponible para inspección en IA de alto riesgo), y también para comunicar confianza a socios o inversionistas (quienes valoran que el producto esté bien controlado).

- Sigue estándares y certificaciones voluntarias: Aunque en tu país no obliguen a nada específico aún, adopta estándares reconocidos. Por ejemplo, sigue las fases del NIST AI Risk Management Framework (Identificar riesgos, Minimizarlos, Gestionarlos, etc.) en tu organización. O revisa las normas ISO emergentes sobre IA (la ISO está desarrollando estándares para gestión de IA responsable). En España, AENOR y otros ofrecen certificaciones de “IA confiable” basadas en el cumplimiento de ciertas buenas prácticas; obtener esas certificaciones puede adelantarte a requisitos legales y ser un sello de calidad para tus clientes. Si estás en un sector particular (salud, automoción), infórmate de guías específicas: ej., la FDA en EE.UU. tiene orientaciones para algoritmos médicos; cumplirlas te abrirá puertas y te mantendrá seguro legalmente. El punto es voluntariamente elevar el listón de tu IA a niveles ya recomendados por expertos, así cuando las leyes lleguen no tendrás que hacer cambios drásticos porque ya estabas alineado.

- Aspectos contractuales y de proveedores: Muchas empresas usan modelos de terceros o APIs (por ejemplo, integrar la API de OpenAI en tu producto, o usar un servicio de reconocimiento facial de una compañía externa). Debes asegurarte de que esos proveedores también cumplen con regulaciones. Por ejemplo, bajo la ley europea, si tu producto final es de alto riesgo y usas componentes de IA de terceros, tendrás que garantizar que esos componentes cumplen requisitos técnicos. Empieza a exigir en tus contratos con proveedores cláusulas de cumplimiento: que te informen sobre los riesgos de su modelo, que te permitan auditar de cierta forma, que se comprometan a corregir fallos de seguridad. Igualmente, si tu empresa proporciona un servicio de IA a otra (eres un proveedor B2B), prepárate para responder a sus diligencias: muchos clientes corporativos ya antes de comprarte te envían cuestionarios de ética de IA o requisitos de GDPR. Si ya tienes todo documentado y puedes demostrar que tu IA es segura y ética, ganarás clientes. La cadena de valor entera de IA se está regulando, así que tanto hacia arriba (tus proveedores) como hacia abajo (tus clientes) deben estar sincronizados en cumplir la ley.

- Establece un equipo o responsable de cumplimiento de IA: En empresas más grandes, se recomienda formar un comité de ética de IA o al menos designar a alguien (un “AI Compliance Officer” quizá) que supervise estos temas. En una startup pequeña, tal vez sea el propio CTO o CEO inicialmente, pero lo importante es que alguien esté pendiente de las actualizaciones normativas, de revisar las decisiones de diseño con perspectiva ética/legal, y de entrenar al resto del equipo en buenas prácticas. De forma análoga a como muchas empresas hicieron con la figura del DPO (Delegado de Protección de Datos) tras la llegada de GDPR, podría surgir la necesidad de responsables internos para IA. Anticípate creando esa conciencia en tu organización. Documenta las reuniones o debates sobre posibles dilemas éticos del proyecto, cómo se resolvieron… eso muestra cultura de cumplimiento.

- Informa y forma a tu equipo y stakeholders: La capacitación es clave. Asegúrate de que los desarrolladores entienden por qué se toman ciertas precauciones, cuáles son las implicaciones legales de, por ejemplo, usar una determinada base de datos para entrenar. Igualmente, el equipo de negocio debe saber qué promesas puede o no hacer a clientes respecto a la IA (evitar publicidad engañosa es crucial). Si vendes tu IA a terceros, ofrece material claro sobre cómo usarla de manera responsable y conforme a la ley (por ejemplo, si provees un sistema de videoanálisis de seguridad a empresas, adviérteles sobre respetar leyes locales de vigilancia o de trabajo). En resumen, la compliance debe ser parte de la cultura de la empresa, no una lista de verificación externa. Esto reducirá riesgos de incumplimiento involuntario.

- Atención a la regulación futura: Por último, mantente al día de los cambios. Suscríbete a boletines de actualización legal en tecnología, sigue a autoridades o expertos en redes, participa en asociaciones de la industria que dialogan con reguladores. Muchas veces los gobiernos piden comentarios a la industria antes de finalizar una ley; esa puede ser una oportunidad de influir o al menos prepararse. También observa las tendencias: por ejemplo, si notas que varios países están legislando sobre IA en reclutamiento, y tu producto es de ese rubro, sabes que es cuestión de tiempo que toque tu puerta. Mejor adaptarte voluntariamente ya a lo que esas leyes generalmente requieren.

En resumen, cumplir con las leyes de IA requiere proactividad. No hay que esperar a que la multa llegue, sino incorporar desde ya principios de legalidad, ética y transparencia en el desarrollo y uso de IA. Para un emprendedor o agencia, esto también es un factor de competitividad: muchos clientes valorarán y preferirán soluciones que puedan demostrar que son “de fiar” y cumplen normas. Así que más que verlo solo como una carga, puede ser un diferenciador positivo en un mercado cada vez más consciente.

¿Cómo prepararse para cumplir con las normativas emergentes?

Además de lo anterior, que son pasos concretos, conviene tener una estrategia de preparación dado que el entorno legal de la IA evoluciona. Algunas ideas clave para estar preparado:

- Adopta el cambio regulatorio como parte de la planificación de negocio: Igual que una empresa hace planificación financiera a futuro, incluye la variable regulatoria en tu hoja de ruta. Por ejemplo, si sabes que en 2026 la UE exigirá X cosa, planifica tener esa funcionalidad lista en 2025 para testearla. Anticipa posibles costos (¿necesitarás contratar un auditor externo? ¿certificar algo? Añade eso al presupuesto a futuro). Considera también escenarios: ¿qué harías si de pronto una ley en cierto país te impide usar un componente de tu IA? Mejor investigar alternativas desde antes que verte frenado. La agilidad para adaptarse será crucial.

- Mantén tu tecnología adaptable: Es decir, diseña tus sistemas de forma modular y actualizable. Si mañana un reglamento dice que necesitas registrar las decisiones de tu IA, ¿puedes habilitar un módulo de logging sin reescribir todo? Si te piden cambiar o eliminar ciertos datos de entrenamiento por privacidad, ¿tienes cómo reentrenar o refinar tu modelo con nuevos datos fácilmente? La arquitectura flexible y la documentación te ayudarán a hacer ajustes sin tener que empezar de cero. Esto incluye tener pipelines de ML reproducibles (para rehacer un modelo cumpliendo un nuevo requerimiento) y estar al día en técnicas de AI governance (muchas herramientas están surgiendo para ayudar a monitorear, explicar y controlar modelos —valóralas para integrarlas a tu stack).

- Enfócate en la calidad y robustez de tus modelos: Cuanto mejor funcione tu IA (precisa, con menos errores), menos probabilidades de causar incidentes que atraigan la ira de un regulador. Por ejemplo, si desarrollas un sistema de conducción autónoma, es obvio que debes buscar la máxima seguridad posible no solo por el usuario sino porque un accidente puede derivar en suspensión de permisos. En sistemas menos críticos igual aplica: un chatbot que ocasionalmente insulta usuarios por un fallo podría terminar siendo prohibido en alguna jurisdicción por “falta de control”. Por tanto, invierte en pruebas extensivas, validaciones en entornos reales y mejoras continuas. Demuestra que tienes un ciclo de vida de producto donde detectas y corriges problemas rápidamente. Las normas europeas de IA de alto riesgo de hecho exigirán algo así como post-market monitoring, es decir, que tras lanzar sigas evaluando el rendimiento del sistema y reportando problemas. Adelántate incorporando ese hábito de monitorizar.

- Diseña con opciones de intervención humana: Muchas regulaciones insisten en la supervisión humana. A nivel práctico, esto quiere decir que, en tu producto, incluyas controles manuales o verificaciones donde tenga sentido. Por ejemplo, si ofreces una IA que redacta informes automáticamente, quizá permite que un humano revise y edite antes de mandarlo al cliente final (y házselo saber a tus clientes: “recomendamos revisión humana”). Si tienes un proceso automatizado, deja una puerta para que un empleado intervenga cuando hay casos atípicos. En servicios al consumidor, siempre da un canal para hablar con una persona si la IA no resolvió el problema. Estas medidas no solo cumplen con posibles requisitos legales de “derecho a intervención humana”, sino que también mejoran la satisfacción y seguridad.

- Prepara políticas y manuales internos: Así como las empresas tienen manuales de conducta o protocolos de seguridad laboral, elabora una política interna para desarrollo y uso de IA. En ella puedes compilar todo lo dicho: compromiso con no discriminación, proceso de escalamiento en caso de hallarse un fallo grave en la IA, roles y responsabilidades (quién debe aprobar un despliegue de un modelo nuevo, por ejemplo). También planifica un procedimiento de respuesta si algo sale mal: ¿qué harás si tu IA comete un error significativo que afecta a usuarios? Tener un plan (notificar a afectados, corregir el error, documentar el incidente, cooperar con autoridades si aplica) es esencial. Esto muestra madurez ante socios y te permitirá reaccionar ordenadamente, minimizando daños legales y reputacionales.

- Asesórate legalmente llegado el caso: Para cuestiones complejas, no dudes en buscar asesoría legal especializada en tecnología. Por ejemplo, si vas a lanzar un producto de IA al mercado europeo y no estás seguro si encaja en alto riesgo o no, un abogado o consultor en regulación de IA puede hacer un assessment. O si te llega un requerimiento de una autoridad (digamos, una agencia de datos que pregunta por tu modelo), involucra a tu asesoría legal para responder adecuadamente. La inversión en entender bien las obligaciones con ayuda de expertos puede ahorrarte multas después. Muchas firmas legales grandes están montando equipos de “AI compliance” justamente para esto; aprovéchalo si estás en sectores críticos.

- Comunica abiertamente con usuarios sobre la IA: Una preparación más hacia afuera: la transparencia con los usuarios también prepara el terreno para el cumplimiento. Educa a tus usuarios o clientes sobre qué hace tu IA, qué no hace, cuáles son sus limitaciones. Establece expectativas reales. Muchas crisis vienen de que un usuario pensó que la IA era infalible y no lo era. Si vendes un software de IA a empresas, ofréceles training o materiales para que ellos a su vez lo usen correctamente (por ejemplo, un banco usando tu IA debe entender cómo interpretarla para no delegar ciegamente decisiones). Esta comunicación abierta te ayuda a prevenir malentendidos que podrían terminar en quejas formales o en mala prensa. Además, si llegase un escrutinio público o de un regulador, poder demostrar que no ocultas nada y que informas a los usuarios juega a tu favor.

- Mantén una actitud ética más allá de la ley: Finalmente, aunque suene abstracto, es importante. Las leyes marcarán mínimos, pero la responsabilidad social de los creadores de IA va más allá. Si siempre te preguntas “¿Esto podría causar daño? ¿Qué más podríamos hacer para evitar un mal uso?”, seguramente estarás cumpliendo con cualquier regulación sin problema, porque estarás excediendo esos mínimos. Por ejemplo, quizá en tu país no hay ley que diga que no manipules emocionalmente al usuario con tu IA, pero éticamente sabes que no está bien diseñar un bot que se aproveche de usuarios vulnerables. Al actuar con ese sentido ético, evitas futuros problemas (posiblemente se convertirían en prohibiciones legales luego). Construye IA que beneficie genuinamente a tus usuarios y minimice riesgos. Esa es la mejor preparación a largo plazo: alinear tus objetivos empresariales con el bienestar del usuario y la sociedad, que al fin y al cabo es lo que las regulaciones buscan garantizar.