Modelos multimodales de AI

¿Qué significa “multimodal” en IA?

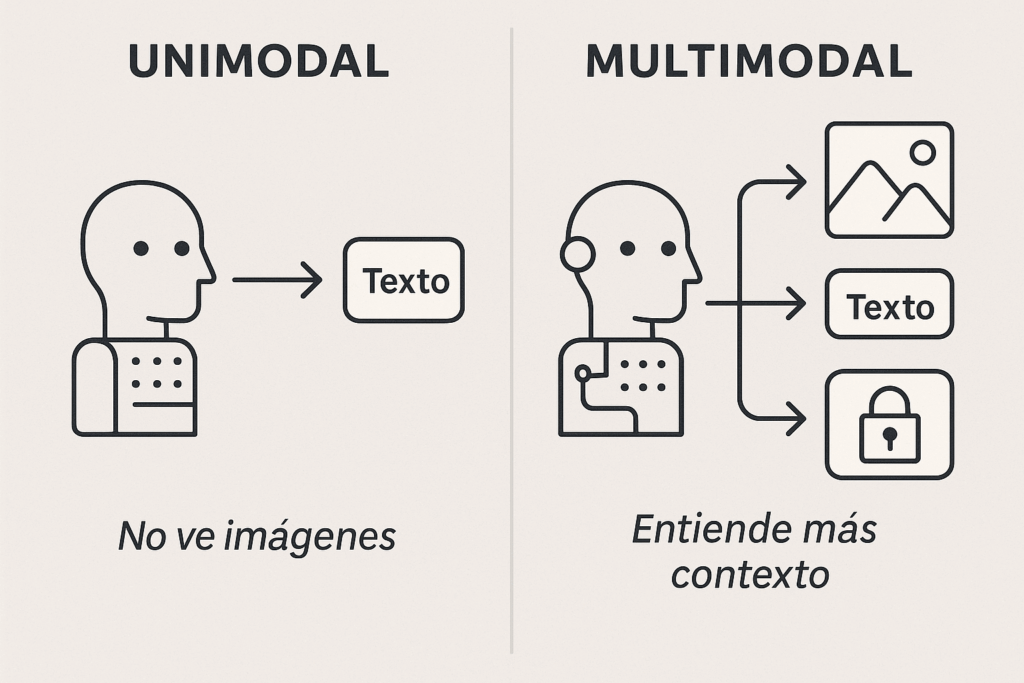

Inteligencia Artificial multimodal se refiere a sistemas capaces de procesar e integrar varios tipos de datos o “modalidades”. A diferencia de una IA tradicional que solo maneja texto, imagen o audio por separado, una IA multimodal puede combinar texto, imágenes, audio e incluso vídeo simultáneamente. Esto imita la forma en que los humanos usamos múltiples sentidos para entender el mundo: por ejemplo, un humano puede ver una escena, escuchar sonidos y leer textos al mismo tiempo para formarse una comprensión más completa. Del mismo modo, una IA multimodal podría, por ejemplo, analizar una fotografía mientras escucha una descripción hablada de la misma, integrando ambas fuentes de información para responder con mayor precisión. En resumen, “multimodal” significa multisensorial en términos digitales: la capacidad de entender y generar contenidos en diversas formas (lenguaje, visual, sonoro, etc.) de manera coordinada.

¿Por qué es importante? Porque permite interacciones más naturales y ricas con la tecnología. Un asistente virtual multimodal podría entender nuestras palabras y también las imágenes que le mostremos, o responder con texto y elementos visuales juntos. Esto abre la puerta a aplicaciones más sofisticadas y cercanas a cómo las personas realmente comunicamos información.

Evolución histórica de los modelos multimodales

La idea de combinar varias modalidades en una máquina no es completamente nueva. Ya en los inicios de la IA se soñaba con sistemas que pudieran “ver” y “escuchar”. Un ejemplo temprano es SHRDLU (1968), un programa pionero que entendía instrucciones en lenguaje natural (texto) para mover objetos en un mundo virtual de bloques; aunque muy básico, fue de las primeras demostraciones de una computadora manejando lenguaje y un entorno visual simple a la vez. En las décadas de 1980 y 1990 se dieron pasos importantes: se desarrollaron sistemas de reconocimiento de voz (que convertían audio en texto) y sistemas de visión por computador (que interpretan imágenes), e incluso se experimentó con combinar estas capacidades. Sin embargo, en aquella época las modalidades solían funcionar por separado, cada una con su modelo independiente, y la “fusión” era limitada.

El gran salto llegó en el siglo XXI con el auge del aprendizaje automático (machine learning) y en especial del aprendizaje profundo (deep learning). Estas técnicas permitieron manejar enormes volúmenes de datos variados y encontrar patrones complejos. Aparecieron entonces sistemas multimodales comerciales: por ejemplo, Siri (2011) de Apple, uno de los primeros asistentes virtuales populares, combinó reconocimiento de voz (audio a texto) con comprensión de lenguaje para ejecutar acciones; también las cámaras inteligentes de los coches autónomos empezaron a integrar cámaras, radares y sensores láser para “entender” el entorno en 360º. A mediados de la década de 2010 se introdujeron los modelos generativos de imágenes, como las GAN (redes generativas antagónicas), que si bien inicialmente solo generaban imágenes a partir de ruido aleatorio, abrieron paso a sistemas capaces de generar imágenes a partir de descripciones textuales, lo que ya es un caso de IA multimodal (texto → imagen).

Hacia 2020 en adelante, la multimodalidad cobró protagonismo central. OpenAI lanzó CLIP (2021), un modelo que aprendió relaciones entre texto e imágenes “emparejándolos”: por ejemplo, asociando descripciones con fotos correspondientes. CLIP entendía conceptos visuales en lenguaje natural y sirvió como base para herramientas creativas (como generadores de arte a partir de texto). Poco después vimos una carrera intensa: empresas y laboratorios desarrollando modelos fundacionales multimodales que pueden ingerir varios tipos de datos. Un hito fue GPT-4 (2023), de OpenAI, primer modelo de lenguaje masivo que también aceptaba imágenes como entrada además de texto, pudiendo analizar y describir imágenes o diagramas. Desde entonces, la tendencia ha sido clara: combinar más modalidades para hacer IA más poderosa y versátil.

¿Cómo funcionan internamente estos modelos?

Lograr que una IA maneje múltiples modalidades es complejo, porque cada tipo de dato es diferente. ¿Cómo entiende una imagen comparado con un texto? En términos simples, estos modelos cuentan con módulos especializados para cada modalidad y luego una forma de fusionarlos:

- Encoders especializados: El sistema suele tener componentes que traducen cada modalidad a un formato común interno. Por ejemplo, para las imágenes se usan redes neuronales convolucionales o transformers visuales que convierten píxeles en vectores (números que capturan características visuales); para el texto se usan modelos de lenguaje que convierten palabras en vectores semánticos. Lo mismo con audio: una red neuronal puede transformar una onda sonora en datos que representen palabras o tonos.

- Espacio de representación común: Una vez que cada modalidad está convertida en vectores numéricos, el modelo las proyecta a un espacio multidimensional común. En ese espacio matemático, conceptos similares tienden a estar cerca sin importar su origen. Por ejemplo, la idea de “gato” podría terminar representada de forma parecida tanto si proviene de una foto de un gato como de la palabra “gato” en texto.

- Fusión y atención cruzada: Los modelos multimodales modernos emplean mecanismos de atención (de los Transformers) que les permiten relacionar información de distintas fuentes. En la práctica, el modelo aprende a “prestar atención” a las partes relevantes de cada entrada. Si le preguntas en texto “¿Qué hay en esta imagen?” y le proporcionas una foto, el modelo cruzará la pregunta (texto) con las regiones de la imagen, identificando que “esta imagen” se refiere a cierto contenido visual, y destacará los elementos visuales importantes para responder. Esta técnica se llama a veces atención cruzada porque conecta, por ejemplo, palabras de la pregunta con píxeles de la imagen.

- Entrenamiento conjunto: Para que lo anterior funcione, los modelos se entrenan con datos combinados. Por ejemplo, millones de imágenes con sus descripciones textuales, videos con sus transcripciones de audio, etc. Así aprenden las correlaciones entre cada modalidad. Un resultado del entrenamiento es que el modelo “aprende” que la palabra “perro” suele asociarse a cierta figura visual (un animal de cuatro patas), o que un sonido de ladrido corresponde a ese concepto.

- Generación multimodal: Internamente, una vez que el modelo tiene esa representación unificada, puede generar salidas en cualquiera de las modalidades que conozca, a partir de la representación común. Si el modelo está diseñado para generar texto, imagen o audio, podrá convertir el entendimiento interno en la salida deseada. Por ejemplo, un mismo modelo podría mirar una foto y generar una descripción escrita (imagen → texto), o leer un párrafo y dibujar una ilustración correspondiente (texto → imagen), según cómo fue entrenado y configurado.

En resumen, estos modelos funcionan creando un “lenguaje común interno” para imágenes, sonidos y palabras. Técnicamente, muchas arquitecturas actuales usan Transformers (el tipo de red neuronal detrás de los grandes modelos de lenguaje) adaptados para distintas modalidades, y luego unen sus salidas. Así logran razonar sobre, digamos, una pregunta textual con referencia a una imagen, de forma conjunta. Es un proceso complejo, pero conceptualmente es como tener expertos en cada tipo de dato colaborando dentro de la red neuronal y poniéndose de acuerdo para dar una respuesta coherente uniendo todas las pistas disponibles.

Modelos multimodales actuales destacados

La revolución multimodal está en marcha y varios modelos punteros la lideran. Estos son algunos de los más relevantes hoy:

- GPT-4 y GPT-4o (OpenAI)

GPT-4 fue lanzado en 2023 como un modelo multimodal capaz de recibir imágenes además de texto. Esto significa que a GPT-4 se le podía mostrar, por ejemplo, la foto de un cartel y pedirle que lo tradujera, o un diagrama y preguntarle por su contenido.Posteriormente, en 2024, OpenAI presentó GPT-4o (GPT-4 “omni”), una versión mejorada y multilingüe de GPT-4. GPT-4o amplió las capacidades multimodales, permitiendo procesar y generar texto, imágenes e incluso audio. Esto lo convierte prácticamente en un asistente capaz de ver y escuchar. Por ejemplo, GPT-4o podría transcribir audio, analizar la transcripción junto con imágenes relacionadas y responder en español u otros idiomas. Además, OpenAI optimizó esta versión para que fuera más rápida y accesible (con una API más veloz y económica que la de GPT-4 original). En definitiva, la familia GPT-4 representa cómo un modelo de lenguaje tradicional se ha transformado en un sistema multimodal versátil. - GPT-5 (OpenAI)

OpenAI presentó GPT-5 como la evolución natural de la serie GPT-4, consolidando aún más la multimodalidad. GPT-5 integra de manera nativa texto, imágenes, audio y video, y está diseñado para razonar y planificar a largo plazo. Se describe como un sistema más coherente y contextual, capaz de mantener conversaciones fluidas mientras analiza simultáneamente datos visuales o auditivos. Además, incorpora optimizaciones que lo hacen más eficiente en coste y velocidad, ampliando la accesibilidad a desarrolladores y empresas. GPT-5 representa el siguiente paso en la visión de asistentes universales de inteligencia artificial. - Gemini (Google DeepMind)

Gemini es el nombre del modelo multimodal de próxima generación de Google, anunciado en 2023 y lanzado en 2024/2025. Gemini se concibió desde cero como multimodal: puede manejar texto, imágenes, audio, vídeo e incluso código.Google entrenó a Gemini con enormes conjuntos de datos diversos, que incluyen desde transcripciones de vídeos de YouTube (para relacionar habla y contenido visual) hasta imágenes etiquetadas de Google Images y código fuente de repositorios. La promesa de Gemini es unir en un solo modelo lo mejor de varios mundos: las capacidades conversacionales tipo ChatGPT, el razonamiento lógico (incorporando técnicas de AlphaGo/AlphaZero para planificación), y el entendimiento visual/auditivo avanzado.En aplicaciones prácticas, un solo modelo Gemini podría mantener una conversación, describir una fotografía, entender un clip de vídeo y escribir fragmentos de código para resolver un problema, todo en la misma sesión. Esto lo hace especialmente atractivo para integrarlo en asistentes personales o en herramientas profesionales donde diversos tipos de datos se usan a la vez. - Claude (Anthropic)

Claude es la familia de asistentes de IA desarrollados por la empresa Anthropic. Actualmente (Claude 2, por ejemplo) es principalmente un modelo de lenguaje enfocado en texto, rival de ChatGPT, conocido por manejar contextos muy amplios (documentos largos).Aunque hoy en día Claude no es plenamente multimodal en producción, merece mención porque forma parte de los modelos de IA de última generación. Anthropic ha indicado interés en incluir modalidades adicionales en el futuro, por lo que es posible que veamos versiones de Claude capaces de analizar imágenes o audio. Un hipotético “Claude multimodal” permitiría a las empresas analizar conjuntos de datos que incluyan texto e imágenes conjuntamente, o brindar soporte al cliente donde los usuarios puedan adjuntar capturas de pantalla de un problema.

- Otros ejemplos notables:

- Bard (Google) es otro modelo de lenguaje que, aunque nació como texto, posteriormente integró algunas funciones visuales (por ejemplo, puede responder mostrando imágenes relevantes de búsqueda y admite que el usuario le provea imágenes en la consulta, apoyándose en Google Lens para entenderlas). Bard ejemplifica cómo los asistentes de IA están sumando modalidades poco a poco.

- Modelos de generación de imágenes y video: como DALL-E 3 (integrado en ChatGPT) o Stable Diffusion y MidJourney, que convierten texto en imágenes, son multimodales en el sentido de que conectan lenguaje e imágenes. De forma inversa, modelos como Imagen Captioning (descripción de imágenes) o Whisper(reconocimiento de voz a texto, de OpenAI) conectan modalidades para, respectivamente, describir visuales en texto o transcribir audio a texto. Si bien suelen ser herramientas especializadas, forman parte del ecosistema multimodal al combinarlas en flujos de trabajo.

- Sistemas de conducción autónoma y robótica: Por fuera del dominio “chatbot”, vale la pena destacar que un coche autónomo como el Autopilot de Tesla es esencialmente una IA multimodal: combina cámaras (visión), radares y sensores LiDAR, junto con datos de GPS/mapas, para tomar decisiones de conducción. Integra múltiples fuentes para “entender” su entorno (señales, peatones, otros vehículos) y actuar en consecuencia. En robótica también se trabaja en agentes que usan visión, tacto y audio para interactuar con su entorno de forma coordinada.

- Asistentes domésticos inteligentes: como Amazon Alexa o Google Assistant, que escuchan tu voz (audio) y te responden con voz generada, a veces mostrando información en pantalla (texto/visual). Si bien originalmente se centraban en voz, con pantallas inteligentes ahora combinan visual y auditivo (por ejemplo, uno puede preguntarle a Alexa por el clima y no solo te lo dice, sino que muestra en pantalla íconos del pronóstico). Esto demuestra otra cara de la multimodalidad en productos cotidianos.

- Bard (Google) es otro modelo de lenguaje que, aunque nació como texto, posteriormente integró algunas funciones visuales (por ejemplo, puede responder mostrando imágenes relevantes de búsqueda y admite que el usuario le provea imágenes en la consulta, apoyándose en Google Lens para entenderlas). Bard ejemplifica cómo los asistentes de IA están sumando modalidades poco a poco.

En resumen, el panorama actual de modelos multimodales incluye desde gigantes generalistas (GPT-5/Gemini) hasta sistemas especializados (reconocimiento de voz, generadores de imágenes) que, al conectarse, ofrecen experiencias integrales. Cada modelo nuevo tiende a ser más “todoterreno”, y la línea entre texto, imagen, audio o video se está difuminando en el ámbito de la inteligencia artificial.

Aplicaciones actuales y futuras de la IA multimodal

Los modelos multimodales ya están encontrando usos en múltiples sectores, y se prevé que transformarán aún más la forma de trabajar, crear y vivir. Veamos aplicaciones concretas, tanto actuales como proyectadas, en distintos ámbitos:

- Creatividad y generación de contenido: Las IA multimodales potencian la creación multimedia. Un ejemplo actual es la generación de contenido marketing: a partir de una descripción de un producto (texto) pueden crear tanto una imagen publicitaria como un jingle corto (audio) o incluso un video promocional simple. Herramientas así permiten a agencias de publicidad o creadores independientes producir materiales visuales y sonoros sin necesitar múltiples equipos especializados. En el ámbito artístico, ya vemos aplicaciones donde un diseñador puede bocetar una idea y la IA la transforma en una imagen refinada aplicando cierto estilo artístico, o músicos utilizando IA que escucha un tarareo (audio) y le acompaña con una base instrumental adecuada. En el futuro, podríamos tener plataformas “todo en uno” donde uno describe verbalmente una escena y la IA genera una animación completa con imágenes, diálogos (voz) y música.

- Educación: La educación se perfila como una gran beneficiaria. Imaginemos tutores virtuales multimodales que puedan ver y oír al estudiante: un alumno podría preguntarle una duda de matemáticas hablándole, mostrarle una foto de un problema escrito a mano o de un gráfico, y la IA entendería la pregunta, examinaría la imagen (por ejemplo un diagrama o la foto de su resolución en papel) y luego le explicaría la solución paso a paso en voz alta, resaltando elementos en la imagen para mayor claridad. Esto combina texto, imagen y audio en una sola interacción educativa. Actualmente ya existen herramientas que resuelven problemas de matemáticas a partir de una foto (como aplicaciones de smartphone), y asistentes de lenguajes que corrigen pronunciación analizando audio del alumno. A futuro, estos podrían unirse en tutores personalizados que detectan si el estudiante está confundido por su tono de voz o expresión facial (vídeo), y adaptan la explicación en consecuencia – un verdadero profesor virtual multisensorial.

- Salud y medicina: En medicina, la IA multimodal ya se aplica en tareas de diagnóstico asistido. Por ejemplo, un sistema puede tomar en cuenta imágenes médicas (radiografías, resonancias) junto con texto (historial clínico del paciente, anotaciones del médico) para sugerir diagnósticos o destacar áreas anómalas. Un radiólogo con una IA así dispondrá de una segunda opinión que relaciona lo que “ve” en la imagen con los síntomas descritos. Otra aplicación emergente es en telemedicina: un paciente en casa podría describir sus síntomas verbalmente a un asistente de IA y mostrar por cámara una lesión visible; la IA integraría ambas entradas para ofrecer un primer análisis o recomendar atención inmediata si detecta algo preocupante. En investigación médica, modelos que combinen literatura científica (texto), bases de datos genéticas y resultados de laboratorio (tablas, imágenes de microscopio) podrán descubrir correlaciones o predecir efectos de nuevos fármacos de forma más integral que analizando cada cosa por separado.

- Negocios y análisis de datos: Las empresas manejan datos de muchas formas: documentos, hojas de cálculo, presentaciones gráficas, correos electrónicos, reuniones grabadas en audio/vídeo… Las IA multimodales pueden convertirse en asistentes corporativos que absorben todo ese contenido. Por ejemplo, un ejecutivo podría preguntar a una IA: “¿Cómo estuvieron nuestras ventas el último trimestre comparado con imágenes de flujo de clientes en tiendas físicas?” y la IA podría analizar el informe financiero (texto y números) junto con imágenes de las cámaras de las tiendas (visual, incluso vídeo) para detectar patrones (quizá relacionar el aumento de ventas con horas de mayor afluencia que observa en los vídeos). También en marketing se usan IA que analizan redes sociales: combinan texto (comentarios, reseñas) con imágenes compartidas por clientes para entender la percepción de una marca. Responden preguntas complejas como “¿Qué tipo de ambientes aparecen con más frecuencia junto a nuestro producto en fotos de Instagram y qué dicen los usuarios en esas publicaciones?”. Antes habría que revisar manualmente; ahora una IA puede ver las fotos y leer las descripciones para dar una respuesta unificada. A futuro, prácticamente cualquier análisis de business intelligence podría hacerse multimodalmente, ya que los datos empresariales vienen en todos los sabores.

- Atención al cliente y asistentes virtuales: Los chatbots de soporte están evolucionando a agentes multimodales. Imaginemos el soporte técnico: un cliente chatea con una empresa porque su producto no funciona. En lugar de solo texto, el cliente puede enviar una foto del producto o incluso iniciar una videollamada en la que muestra el problema. La IA del servicio técnico analizará la imagen en tiempo real (reconociendo el modelo del producto, viendo el indicador luminoso, etc.) y escuchará al cliente describir el fallo. Con toda esa información, podrá guiarlo mejor, superando al típico bot scriptado. Hoy se empieza a implementar en sectores como la automoción (asistentes que reconocen el daño de una pieza vía foto) o en apps de soporte de software (donde el usuario comparte pantalla y un agente automatizado detecta dónde hacer clic, etc.). En el futuro, estos agentes podrían también hablar con voz natural, haciendo la interacción aún más humana, o proporcionar respuestas visuales (por ejemplo, marcando en la imagen enviada los pasos a seguir para arreglar algo).

- Entretenimiento y medios: Aquí la multimodalidad está dando lugar a cosas impresionantes. Pensemos en los videojuegos: se está investigando en NPCs (personajes no jugables) controlados por IA multimodal que puedan ver lo que el jugador hace en el juego, escuchar su voz (si el jugador habla por micrófono) y responder con diálogo generado al vuelo y animaciones faciales coherentes. Esto haría los juegos mucho más interactivos y dinámicos. En cine y producción audiovisual, una IA podría asistir en la edición de vídeo: “mira” horas de metraje, lee guiones y edita automáticamente escenas coherentes, o sugiere dónde insertar efectos sonoros. También podríamos mencionar las experiencias de realidad aumentada (AR) y realidad virtual (VR): un futuro asistente AR podría reconocer el entorno que vemos (mediante la cámara) y brindarnos información auditiva al oído o visual superpuesta en nuestros lentes. Por ejemplo, uno camina por un museo con gafas AR: la IA reconoce la pintura que miramos y nos habla (audio) contando su historia, e incluso podría mostrarnos una recreación animada (video) de cómo se pintó. Todo en uno.

- Aplicaciones cotidianas: En la vida diaria ya usamos pequeñas ayudas multimodales: la función de los móviles de “apunta con la cámara y traduce el texto en pantalla” (Google Lens, por ejemplo) combina visión + lenguaje. Los filtros de redes sociales que reaccionan a gestos (vídeo + reconocimiento facial + efectos visuales) o apps que convierten palabras habladas en subtítulos en vivo (audio + texto) son otros ejemplos. Estas son soluciones específicas; en el futuro cercano podríamos tener un “asistente personal universal” en el móvil que ve a través de la cámara, oye por el micrófono y habla/responde por la pantalla y altavoz para ayudarnos en cualquier tarea: desde decirnos si la comida que estamos cocinando “se ve lista” mediante la cámara, hasta enseñarnos cómo arreglar una bicicleta mientras detecta qué pieza tenemos en las manos y nos guía paso a paso.

En conclusión, las aplicaciones de la IA multimodal van desde lo mundano a lo extraordinario. Cualquier tarea donde confluyen distintos tipos de información es candidata a beneficiarse. Esto supone ahorros de tiempo, nuevas experiencias más ricas y personalizadas, y también desafíos (veremos en la siguiente sección qué implica todo esto para el futuro).

Implicaciones para el futuro de la IA y los negocios

La popularización de los modelos multimodales apunta a un cambio de paradigma tanto en la tecnología como en su impacto socioeconómico. Estas son algunas implicaciones clave:

- Hacia una IA más general y “humana”: Combinar modalidades es un paso esencial hacia la IA general (AGI, por sus siglas en inglés), esa idea de una inteligencia artificial con capacidades similares a la humana en diversos ámbitos. Si una IA puede ver, oír, leer y hablar, tiene más herramientas para entender contextos complejos. Por ejemplo, un robot asistente en un hogar del futuro deberá interpretar órdenes verbales, reconocer objetos y personas visualmente, y quizás leer textos o señales en el entorno para actuar correctamente. Los modelos multimodales actuales son los cimientos de esas futuras IAs integrales. Aún estamos lejos de una IA con sentido común totalmente humano, pero claramente, dotarlas de “sentidos” diversos las acerca más a cómo razona una persona.

- Nuevos modelos de negocio y productos: Para las empresas y emprendedores, la multimodalidad abre un abanico de oportunidades. Se podrán crear productos digitales que antes eran ciencia ficción: asistentes médicos virtuales que revisan radiografías y consultan bases de datos médicas en segundos, consultores financieros que analizan tendencias de mercado viendo gráficos bursátiles e informes de texto juntos, aplicaciones de turismo donde apuntas la cámara a un monumento y la IA te narra su historia en tu idioma… Los negocios que adopten estas tecnologías temprano podrán ofrecer servicios más completos y diferenciados. Por ejemplo, en e-commerce, ya se experimenta con buscadores donde subes la foto de una prenda que te gusta y la IA te muestra productos similares en la tienda (imagen + datos de catálogo), o con chatbots de compra a los que puedes decir “busco algo como esto” adjuntando una imagen, en lugar de describirlo con palabras. La experiencia de cliente se hace más natural y eso puede traducirse en más ventas o fidelidad.

- Mayor eficiencia, pero necesidad de adaptación laboral: En muchos trabajos, tener una IA que pueda encargarse de tareas complejas multimodales significará ahorro de tiempo y automatización de procesos. Un ejemplo concreto: un archivista o abogado que deba revisar cajas de documentos y evidencias multimedia – una IA puede “leer” todos los textos, “mirar” fotos o videos de seguridad, transcribir audios y resumir hallazgos clave. Esto libera al profesional de cribar manualmente tanta información y le permite enfocarse en las decisiones. Sin embargo, esta automatización exige adaptación de las personas: habrá que aprender a colaborar con estas IAs, supervisarlas y aprovechar sus resultados. Nuevas habilidades serán valoradas, como saber redactar buenas consultas (prompt engineering) o validar la veracidad de las respuestas de la IA (porque no son infalibles). En suma, la multimodalidad aumentará la productividad, pero también requerirá recualificación de empleados en diversas industrias.

- Desafíos éticos y de privacidad: Un futuro en el que las IAs puedan verlo y oírlo todo también trae preocupaciones. Por ejemplo, una IA multimodal podría potencialmente identificar personas por su cara o voz en vídeos y audios (lo que roza la vigilancia masiva si no se controla), o generar deepfakes muy convincentes mezclando video y audio falsos, con implicaciones serias para la desinformación. Los negocios tendrán que ser conscientes de estos riesgos: una empresa que use un modelo multimodal debe asegurarse de respetar la privacidad (ej., si analizan imágenes de clientes, no violar sus datos personales) y evitar usos maliciosos. Regulaciones (como veremos en la siguiente lección) están emergiendo para encauzar esto. También hay desafíos técnicos como el sesgo: una IA que interprete imágenes y texto podría heredar prejuicios de ambos mundos, por lo que hace falta doblar esfuerzos en auditarlas. En definitiva, el poder de la multimodalidad conlleva la responsabilidad de usarla con ética y supervisión humana para evitar daños.

- Globalización e inclusión: Estas tecnologías bien utilizadas pueden hacer la información y los servicios más accesibles. Pensemos en personas con discapacidad: una IA que “ve” imágenes puede narrarlas para un usuario ciego; o una IA que “escucha” y transcribe audio puede ayudar a personas con discapacidad auditiva a recibir la información por escrito. La multimodalidad permitirá interfaces adaptadas a cada persona: quien no pueda escribir, podrá hablar o mostrar imágenes para interactuar con el sistema. Además, al soportar múltiples idiomas (como GPT-4o, Gemini y otros que son multilingües), se reduce la barrera idiomática en el acceso a recursos. Para los negocios, esto significa poder llegar a más público y atender mejor las necesidades de distintos grupos, fomentando una inclusión digital mayor.

En resumen, los modelos multimodales van a potenciar la próxima ola de innovación en IA. Las empresas deben prepararse para integrarlos en sus estrategias, ya que quienes aprovechen antes sus capacidades tendrán ventaja competitivacreando productos más inteligentes y experiencias de usuario más ricas. Pero también deberán hacerlo con cuidado, entendiendo las nuevas responsabilidades que implican estas poderosas herramientas.